»Sano ei tappajaroboteille!»

Human Rights Watchin vuonna 2013 käynnistämän kampanjan sanavalinta on tietoisen kärjistetty. Se tuo mieleen Terminator-elokuvien kaltaiset kauhukuvat älykkäistä koneista, jotka pyrkivät pyyhkimään tieltään koko ihmiskunnan.

Kampanja koskee kuitenkin hieman arkisempaa aseteknologiaa. Virallisesti puhutaan tappavaa voimaa käyttävistä autonomisista asejärjestelmistä (lethal autonomous weapons systems eli LAWS).

Autonomisiin aseisiin liittyvät huolet kytkeytyvät yleisempään keskusteluun siitä, voiko riittävän pitkälle kehittynyt tekoäly muodostaa ihmiskunnalle eksistentiaalisen uhan. Lukuisat tekoälyn kanssa toimivat tutkijat ja yrittäjät, kuten Teslan perustaja Elon Musk ja DeepMindin Demis Hassabis, ovat antaneet Human Rights Watchin kampanjalle tukensa.

Myös YK:n pääsihteeri António Guterres nosti autonomiset aseet esiin syyskuun lopussa puhuessaan YK:n yleiskokoukselle. Guterres totesi, että ajatus koneista, joilla on päätösvalta ihmishengen riistämisestä, on moraalisesti vastenmielinen.

Moraalikysymysten lisäksi autonomiset aseet ovat ongelmallisia kansainvälisen humanitaarisen oikeuden näkökulmasta. Kenellä on vastuu, jos autonomisesti toimiva ase syyllistyy esimerkiksi siviilien surmaamiseen? Aseen ohjelmoijalla, sen operaattorilla vai kyseisen joukko-osaston komentajalla?

Lisäksi uhkaksi nähdään, että autonomisten aseiden kehittäminen johtaa samantapaiseen kilpavarusteluun, joka vallitsi kylmän sodan aikana suurvaltojen välillä.

Autonomisilla aseilla on myös puolustajansa – eikä pelkästään sotilaiden ja asevalmistajien joukossa. Robotiikan professori Ronald C. Arkin Georgia Institute of Technologysta on pyrkinyt vakuuttamaan ihmisiä siitä, että autonomiset asejärjestelmät voisivat säästää ihmishenkiä – eikä pelkästään oman puolen vaan myös vihollisen.

»En kannata autonomisia aseita tai aseita ylipäätään, ja vastustan tappamista kaikissa muodoissaan», Arkin toteaa. »Mutta on todettava, että vallitseva tilanne sodankäynnin siviiliuhrien osalta on täysin mahdoton hyväksyä.»

Kyse on psykologiasta ja siitä, että juuri epäinhimillisyytensä vuoksi koneet voisivat kyetä ihmissotilaita humaanimpaan toimintaan taistelukentällä.

Sotimiselle on pyritty luomaan sivistyneet säännöt Geneven sopimuksilla. Vilkaisu sotahistoriaan muistuttaa kuitenkin siitä, että näille säännöille viitataan usein kintaalla. Vihollisen vankeja ja siviilejä nöyryytetään, kidutetaan, raiskataan ja tapetaan.

Silloinkin, kun sodankäynnin säännöistä pidetään kiinni, sodissa kuolee enemmän ihmisiä kuin operatiiviset päämäärät edellyttäisivät yksinkertaisesti siksi, että ihmiset tekevät hätiköityjä päätöksiä psykologisesti haastavissa tilanteissa.

Koneet eivät stressaannu, ahdistu tai panikoi. Niitä ei motivoisi kostonhimo tai katkeruus. Koneet eivät myöskään pelkää kuolemaa. Kaoottisessa taistelutilanteessa ihmissotilas pyrkii kaikin keinoin säilymään hengissä, ja saattaa »varmuuden vuoksi» ampua pakenevaa tai antautuvaa vihollissotilasta tai siviiliä.

Psykologisten tekijöiden lisäksi koneilla on etunaan kyky käsitellä informaatiota paljon ihmistä nopeammin ja luotettavammin. Sen ansiosta voidaan välttyä tapauksilta, joissa ihmisten tekemät väärät tulkinnat johtavat siviilien tappamiseen.

Arkin nostaa esiin vuonna 1988 sattuneen tapauksen, jolloin yhdysvaltalainen ohjusristeilijä USS Vincennes ampui alas iranilaisen matkustajakoneen. Laivan tietojärjestelmä oli tunnistanut sen siviilikoneeksi, mutta miehistö erehtyi silti pitämään sitä hävittäjänä. 290 ihmistä kuoli.

Sotilaat ovat viimeisiä, jotka haluavat menettää kontrollin aseelliseen toimintaan.

Ihminen on erehtyväinen, mutta niin ovat tietysti koneetkin.

Persianlahden sodan aikana vuonna 1991 amerikkalainen sotalaiva USS Missouri ampui ilmaan silppua harhauttaakseen lähestyvän ohjuksen. Silppu kuitenkin harhautti toisen sotalaivan USS Jarrettin automaattisesti toiminutta Phalanx-ohjustorjuntajärjestelmää, joka ryhtyi tulittamaan Missouria kohti. Ihmisiin ei osunut, ja laivan vahingot jäivät minimaalisiksi.

Irakin sodassa 2003 puolestaan Yhdysvaltain Patriot-torjuntaohjukset ampuivat alas yhden amerikkalaisen ja yhden brittikoneen, joita järjestelmä erehtyi pitämään ohjuksina. Kahdessa tapauksessa kuoli yhteensä kolme lentäjää.

Kuuluisa läheltä piti -tilanne on syyskuussa 1983 sattunut tapaus, jossa Neuvostoliiton ennakkovaroitusjärjestelmä antoi hälytyksen, jonka mukaan Yhdysvallat olisi laukaissut mannertenvälisiä ydinohjuksia. Se oli molemmin puolin pelätty tilanne: ensi-isku, johon olisi vastattava nopeasti. Vastuussa ollut everstiluutnantti Stanislav Petrov kuitenkin malttoi mielensä ja arvioi – tai arvasi – että kyseessä oli väärä hälytys.

Kysymys kiertyykin lopulta siihen, kumpaan voi elämän ja kuoleman kysymyksissä luottaa enemmän: koneeseen vai ihmiseen, kaikkine vajavaisuuksineen.

Autonomisista asejärjestelmistä käytävä väittely rinnastuu keskusteluun itseohjautuvista autoista. Robottiautokin voi tehdä virheitä. Ensimmäinen jalankulkijan kuolemaan johtanut onnettomuus sattui viime keväänä Arizonassa.

Onnettomuustutkinnan mukaan auton järjestelmät tunnistivat pimeässä polkupyörää taluttaneen jalankulkijan 1,3 sekuntia ennen törmäystä, mutta auton hätäjarrutusjärjestelmä oli kytketty pois päältä.

»Kun itsestään ajava auto on osallisena liikenneonnettomuudessa, jotkut pitävät sitä suunnilleen maailmanloppuna. Samaan aikaan tieliikenteessä kuolee uskomaton määrä ihmisiä ihmiskuskien virheiden takia, ja se hyväksytään», Arkin ihmettelee.

Arkinin mielestä kannattaisi tarkastella vain nettovaikutusta: vaikka joku joskus kuolisikin tekoälyn virheen takia, tekoälyä kannattaa käyttää, mikäli kuolemia tapahtuu sen ansiosta vähemmän kuin ilman sitä.

Israelin Rautakupoli-torjuntajärjestelmä ampuu alas Gazasta Israeliin ammuttuja raketteja. Kuva: Israel Defence Forces.

Tutkimusjohtaja Pekka Appelqvist puolustusministeriöstä toppuuttelee hieman. Hän pitää aiheesta käytävää keskustelua sinänsä tärkeänä, mutta kansalaisjärjestöjen esiin nostamien uhkakuvien hän katsoo olevan liioiteltuja.

»Nämä uhkakuvat koskettavat usein jotain kuvitteellista tappajarobottia, joka ampuu silmittömästi ympäriinsä niin kauan kuin energiaa ja ammuksia riittää. Ajatus siitä, että mikään järjestäytynyt armeija haluaisi sellaisen rakentaa, on aika kaukaa haettu.»

Appelqvist uskoo, että sotilaiden vaalima komentoketjun eheys toimii rajoitteena sille, miten pitkälle vietyä autonomiaa asevoimat ylipäänsä haluavat ottaa käyttöön.

»Sotilaat ovat viimeisiä, jotka haluavat menettää kontrollin aseelliseen toimintaan.»

Toisaalta Appelqvist suhtautuu tietyllä varauksella myös Ronald Arkinin näkemykseen autonomisten aseiden humaanista vaikutuksesta. Hänen mielestään Arkinin teesit ovat periaatteessa päteviä, mutta teknologian kehityksen suhteen ollaan vielä kaukana tilanteesta, jossa »robottiaseet» tekisivät itsenäisesti niin merkittäviä päätöksiä kuin mitä Arkin kuvailee.

Sekä Arkin että Appelqvist katsovat, että autonomiset aseet voi nähdä ennen kaikkea jatkona täsmäaseiden kehittämiselle. Täsmällisyys vähentää parhaimmillaan sivullisten uhrien määrää.

»Aikaisemmin piti mattopommittaa kokonainen kaupunginosa. Täsmäpommien myötä meni ehkä vain yksi kortteli. Tulevaisuudessa voidaan kenties säästää rakennukset ja sivulliset ihmiset, mikäli isku saadaan kohdistettua yksittäisen taistelijan tarkkuudella», Appelqvist kuvailee.

Suomen kaltaisen korkean teknologian maan Appelqvist uskoo joka tapauksessa olevan kehityksessä pikemminkin hyötyjänä kuin uhkien kohteena.

Meillä on moraalinen vastuu käyttää teknologiaa vähentämään niitä julmuuksia ja virheitä, joita ihmissotilaat tekevät.

Autonomisten aseiden sääntely on otettu asialistalle YK:n tavanomaisia aseita koskevan yleissopimuksen (CCW) kokouksissa. Neuvotteluissa ei ole juuri saavutettu yhteisymmärrystä. Osaltaan niitä on tahmeuttanut se, että osapuolien on ollut vaikea saada sovittua autonomisten asejärjestelmien määritelmästä.

Sitoutumattomien maiden liike on ajanut autonomisten aseiden sääntelyä koskevaa laillisesti sitovaa sopimusta. Myös Euroopan parlamentti on vaatinut autonomisten aseiden kieltämistä, vaikkakaan kaikki EU-maat eivät ole samalla kannalla.

Pieni ryhmä valtioita, joilla on myös merkittävää aseteollisuutta – Yhdysvallat, Venäjä, Israel, Etelä-Korea ja Australia – ei halua sitoutua minkäänlaisiin rajoituksiin. Niiden mukaan asiaa koskeva sääntely olisi ennenaikaista, ja ne haluavat pitää esillä myös autonomisten asejärjestelmien mahdollisia etuja.

Eräänlaisena kompromissina Ranska ja Saksa ovat ehdottaneet poliittista julkilausumaa, jossa linjattaisiin robottiaseiden kehittelyyn ja käyttöön liittyviä periaatteita. Myös Suomi tukee tätä ehdotusta. Julkilausuma ei sitoisi valtioita mihinkään, mutta silti edes siitä ei ole päästy yhteisymmärrykseen.

Varsin laaja konsensus vallitsee kuitenkin siitä, että autonomisissa aseissa on aina pidettävä mukana »merkityksellinen inhimillinen kontrolli». Toisin sanoen pelättyjä tappajarobotteja ei kannata kukaan.

Pekka Appelqvist kuitenkin huomauttaa, että tässäkin määrittelyssä on ongelmansa: mitä merkityksellisyys tarkoittaa?

Appelqvist selventää asiaa esimerkillä: Kuvitellaan ilmatorjuntajärjestelmä, joka tarkkailee ympäristöään tutkien ja sensorien avulla. Kun järjestelmä tunnistaa lähestyvän ohjuksen, se laskee hetkessä sen lentoradan ja antaa sitten hälytyksen ihmiselle, joka istuu bunkkerissa. Tämän jälkeen ihminen tekee päätöksen tulen avaamisesta, mutta hän on täysin järjestelmän algoritmisen havainnointikyvyn ja suositusten varassa – ja päätöksentekoon voi olla alle 20 sekuntia aikaa.

»Ihminen siis painaa nappia, mutta filosofisesti voi kysyä, onko tässä enää kyse aidosti merkityksellisestä ihmisen kontrollista.»

Ronald Arkin muistuttaa, että aseteknologian kehitykseen liittyy ikuinen kamppailu: sotilaat toivovat hyötyvänsä uusista aseista, samalla kun sääntelijät haluavat rajoittaa niiden käyttöä inhimillisyyden nimissä.

Uusien aseiden sääntelyssä on usein onnistututtu vasta sen jälkeen, kun niillä on ensin tapettu riittävän paljon ihmisiä. Esimerkiksi taistelukaasujen käyttö kiellettiin jo Haagin rauhankonferenssissa vuonna 1899, mutta ensimmäisessä maailmansodassa niitä käytettiin hyvin laajasti. Sodan kauhujen jälkeen vuonna 1925 laadittiin uusi kemiallisia ja biologisia aseita koskeva kielto, jota suurin osa maailman maista on noudattanut.

Arkin itse kannattaa autonomisten aseiden sääntelyä mutta ei totaalikieltoa.

»Kielto olisi vähintäänkin ennenaikainen. Mielestäni meillä on moraalinen vastuu käyttää teknologiaa vähentämään niitä julmuuksia ja virheitä, joita ihmissotilaat tekevät.»

Autonomian kolme astetta

Autonomisista aseista puhuttaessa käytetään usein kolmiportaista luokittelua sen mukaan, mikä on ihmisen rooli tietyn laitteen tai järjestelmän toiminnassa.

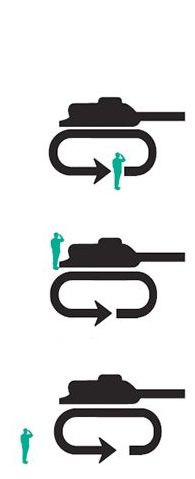

Ihminen päättää (in the loop): Yksinkertaisimmillaan laite voi huolehtia esimerkiksi ympäristön tarkkailusta, kohteiden valinnasta ja maalituksesta, mutta edellyttää ihmiseltä päätöksentekoa tulen avaamisesta.

Ihminen valvoo (on the loop): Toisen asteen autonomiassa laite voi tehdä itsenäisesti päätöksiä myös tulen avaamisesta, mutta sitä valvova ihminen voi milloin tahansa puuttua laitteen toimintaan.

Ihminen ei puutu (off the loop): Kolmannen asteen autonomiasta on kyse silloin, jos ihminen ohjelmoi laitteen ja laittaa sen käyntiin, minkä jälkeen laite pyrkii suorittamaan sille annetun tehtävän, eikä ihminen enää puutu sen toimintaan.

Tutkimusjohtaja Pekka Appelqvist puolustusministeriöstä suhtautuu luokitteluun kriittisesti. Hänen mukaansa se ei tee oikeutta asian monitahoisuudelle.

»Koneautonomia on aina suhteellinen käsite, ei ole mitään absoluuttista autonomiaa. Järjestelmissä voi olla enemmän tai vähemmän autonomisia piirteitä. Niin automaattiset kuin autonomisiksi kutsutut järjestelmät suorittavat joka tapauksessa ihmisen niille määrittämiä tehtäviä.»

Tavallaan jopa yksinkertaisessa maamiinassa on autonomian piirteitä: ihminen asettaa sen paikalleen, mutta ei puutu sen toimintaan. Olennainen ero tulevaisuuden autonomisiin aseisiin on kuitenkin tekoälyn puute. Perinteinen miina ei osaa tulkita tilannetta, vaan räjähtää, kun sen päälle astutaan.